Қателер мен дәлсіздіктер жақында ғылыми журналдарда пайда болды, мысалы, а Егеуқұйрықтардың үлкен жыныс мүшелері бар немесе басқа Адамның аяқтарында сүйектер тым көпбарған сайын кең тарағанын көрсетеді жасанды интеллект (AI) осы жарияланымдарда олардың сапасын төмендетеді.

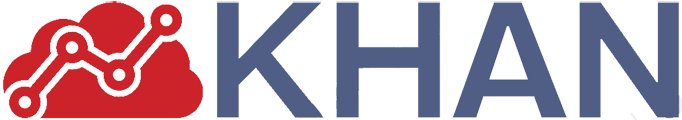

Суретті Frontiers журналы жариялады. Фото: интернет

Суретті Frontiers журналы жариялады. Фото: интернетМамандар сұрақ қойса Олар ChatGPT сияқты құралдардың қызығушылығын мойындайды Мазмұнды жазу, әсіресе ана тілі ағылшын тілінде емес зерттеушілер үшін аударма тұрғысынан бірнеше журналдардың соңғы редакциялары мынаны көрсетеді: адал емес әрекеттер.

Жыл басында, тым үлкен жыныс мүшелері бар тышқанның суретіәлеуметтік желілерде кеңінен таралып, жарияланған зерттеудің кері қайтарылуына әкелді Frontiers University Press журналыосы саладағы маңызды ойыншы.

Өткен айда, Тағы бір зерттеу кері қайтарылды бар жерде адам аяғының бейнесін көрсеткеннен кейін көбірек сүйектер әдеттегіден.

ChatGPT қатесі

Бірақ бұл жалған суреттерден басқа, салаға ең үлкен соққы да келді ChatGPT, американдық OpenAI компаниясы әзірлеген сөйлесу бағдарламасы.

OpenAI логотипі ұялы телефонда компьютер экранының алдында көрінеді. (AP фотосы/Майкл Дуйер, файл)

OpenAI логотипі ұялы телефонда компьютер экранының алдында көрінеді. (AP фотосы/Майкл Дуйер, файл)Наурыз айында британдық Elsevier ғылыми баспа тобы жариялаған мақала «Әрине, бұл сіздің тақырыбыңызға кіріспе болуы мүмкін» деп басталғандықтан, желіде тарады. ChatGPT жауаптарының типтік тұжырымы.

Бұл қателер, ол мамандардың бақылауынан құтылу Кездейсоқ және мүмкін болатын түзету зерттеулеріне жауапты Олар ең беделді журналдардың сүзгісінен өте алмайдыкейбір сарапшылар айтты.

АИ қолдану жиі анықтау қиынбірақ ғылыми әдебиеттерде ол көбейіп бара жатқан сияқты.

Эндрю ГрейЛондон университеттік колледжінің кітапханашысы, AI жиі дұрыс пайдаланбайтын «жетілдірілген», «күрделі» немесе «мадақтауға тұрарлық» сияқты сөздерді іздейтін миллиондаған ғылыми мақалаларды қарап шықты.

Оның айтуынша, 2023 жылға қарай AI көмегімен кем дегенде 60 000 мақала жасаладыжылдық өнім көлемінің 1% және 2024 жылға қарай бұл көрсеткіштердің «айтарлықтай өсуі» болады.

Өз тарапынан американдық қауымдастық Retraction Watch 13 000 элементті рекордтық түрде қайтарып алғанын байқады 2023 жылға қарай ғылым саласында бұрын-соңды болмаған нәрсе.

Өнім зауыты

КЕЛУ Иван Оранскийосы ұйымның құрылтайшыларының бірі, AI енді «алаяқтық» зерттеулердің «индустриалды» өндірісіне мүмкіндік береді. «зауыт» мақаласы арқылы.

ChatGPT логотипі 2024 жылдың 11 наурызында түсірілген бұл суретте пайда болады. REUTERS/Dado Ruvic

ChatGPT логотипі 2024 жылдың 11 наурызында түсірілген бұл суретте пайда болады. REUTERS/Dado RuvicБұл жаппай өндіріс орталықтары сапасыз, плагиат немесе жалған көптеген мақалалар жасау— деді жалған бейнелерді анықтауға маманданған голландиялық микробиолог Элизабет Бик.

Зерттеушілер төлейтін көп өнім өндіруге ынталандырылады, Бұл «зауыттар» жыл сайын жарияланатын зерттеулердің 2% көзі боладыДегенмен, ол АИ-дің арқасында бұл санның «аспанға көтерілгенін» айтты.

Құрметті Оранский, AI «үлкен проблеманы» тудырады: заттарға тойымсыз сұраныс баспалар мен университеттердің өнімдері негізінде бағаланатын зерттеушілерге үлкен қысым жасайды, осылайша «тұйық цикл» жасайды.

Сонымен қатар, осы зерттеу «зауыттарынан» қорғау шаралары жеткіліксіз.

Бұл ауқымды алаяқтық мәселесі американдық Wiley компаниясы 2021 жылы Хиндави баспасын сатып алғаннан кейін ерекше атап өтілді. бұрын сол үй жариялаған 11 300-ге жуық мақаланы қайтарып алды.

Осы өсіп келе жатқан мәселені шешу үшін Уайли іске қосты AI-ны теріс пайдаланатын «өнім зауытын анықтау қызметі».. Бір қызығы, бұл бағдарлама AI-ге негізделген.

Бірақ өткен аптада американдық зерттеуші пайда болған нәрсені ашты ChatGPT өз мақалаларының бірінен қайта жазған нұсқасыWiley журналында жарияланған.

Сэмюэл Пэйнбиоинформатика кафедрасының профессоры Америка Құрама Штаттарының Бригам Янг университетінаурызда зерттеуді тексеруді сұрағанын айтты.

Соны түсінген соң Яғни AI қайта жазған өз жұмысының «плагиаты».жариялауды мақұлдаудан бас тартты.

Пэйн мақаладан бас тартудың орнына, плагиат жұмыстың жай ғана басқа журналда жарияланғанын көргенде «таң қалғанын» айтты.

AFP тілшісі Дэниел Лоулер.